蘋(píng)果冷靜地觀察了生成式AI亢奮的一年,一直在為自己的生態(tài)基礎(chǔ)添磚加瓦,還在一步一個(gè)腳印地邁向明年發(fā)布AiPhone。

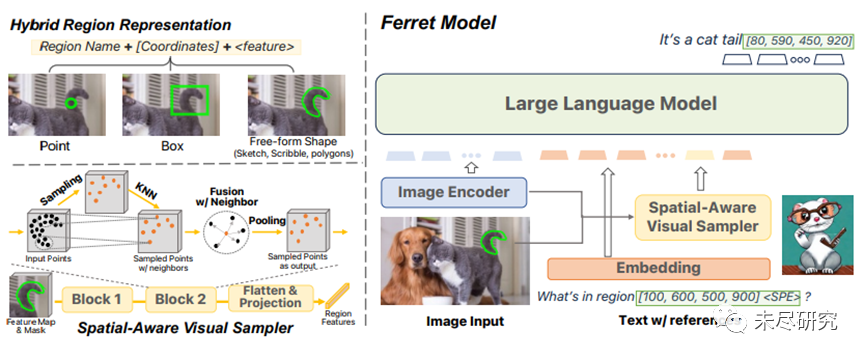

十月份,蘋(píng)果機(jī)器學(xué)習(xí)研究團(tuán)隊(duì)曾推出一個(gè)“雪貂“模型(Ferret),這個(gè)多模態(tài)大模型比GPT-4v對(duì)空間的理解更準(zhǔn)確。最近這個(gè)模型開(kāi)源了。簡(jiǎn)單地說(shuō),在一幅圖中的任何地方,你指出任何一個(gè)物體,哪怕它再微小,“雪貂”都能解釋清楚。

這種對(duì)空間的敏感,對(duì)于蘋(píng)果即將發(fā)布的Vision Pro具有重要作用,它讓自然/虛擬的視覺(jué)感知與語(yǔ)言大模型結(jié)合。這篇不張揚(yáng)的論文作者全部是華人,最近越來(lái)越引起業(yè)內(nèi)的重視,它在空間計(jì)算上達(dá)到了SOTA水平。

“雪貂”模型架構(gòu) (來(lái)源:FERRET: REFER AND GROUND ANYTHING ANYWHERE AT ANY GRANULARITY )

蘋(píng)果最近推出了能在其M3芯片上訓(xùn)練部署大模型的開(kāi)源框架MLX。這意味著Mac筆記本電腦的開(kāi)發(fā)者,可以開(kāi)發(fā)出大模型支持的應(yīng)用。

蘋(píng)果還推出了“閃電大模型” (LLM in a Flash),用閃存解決了手機(jī)上部署大模型內(nèi)存(DRAM)不足的問(wèn)題。

這是個(gè)人很喜歡的一篇論文。是的,偷偷干活的蘋(píng)果,也開(kāi)始默默地發(fā)論文了。

這篇論文談的是一個(gè)小而關(guān)鍵的問(wèn)題,如何在手機(jī)這樣一個(gè)內(nèi)存非常有限的空間里,部署一個(gè)大模型,而且推理的速度要快,還不費(fèi)電池。

它的最大優(yōu)點(diǎn),不是就算法談算法,而是從對(duì)硬件的深刻理解,結(jié)合算法提出了自己的方法。它的出發(fā)點(diǎn)完全是消費(fèi)者思維,大模型在遙遠(yuǎn)的云端,大得嚇人,貴得驚人,只有揣在用戶的口袋里,才能讓消費(fèi)者對(duì)生成式AI產(chǎn)生感覺(jué)。

DRAM太小,放不下一個(gè)幾十億級(jí)的模型。盡管可以放到閃存里,但閃存的帶寬不夠。為了最小化從閃存到DRAM帶寬的負(fù)載,蘋(píng)果創(chuàng)新了兩個(gè)技術(shù),窗口化 (windowing)和行列捆綁 (row-column bundling)(詳見(jiàn)論文)。

在OPT 6.7B和FALCON 7B兩個(gè)模型上測(cè)試,結(jié)果相當(dāng)“炸裂”,能夠運(yùn)行的模型尺寸達(dá)到可用DRAM能容納的兩倍,與CPU和GPU中的簡(jiǎn)單加載方法相比,推理速度分別提高了4~5倍和20~25倍。

對(duì)齊芯片、操作系統(tǒng)和系統(tǒng)設(shè)計(jì),找到方法建立起一個(gè)推理成本模型,這事只有蘋(píng)果做得出來(lái)。

最近一系列的幾十億參數(shù)級(jí)小模型表現(xiàn)當(dāng)驚世界,如Mistral, Phi-2能挑戰(zhàn)百億參數(shù)級(jí)大模型;谷歌推出了18億參數(shù)的Nano級(jí)Gemini模型,直接裝到Pixel手機(jī)上。高通的驍龍芯片能跑得動(dòng)百億參數(shù)級(jí)的模型。三星可能將于2024年初推出生成式AI游戲功能的Galaxy S24手機(jī)。

還有上海交大團(tuán)隊(duì)推出的推理引擎PowerInfer,都為大模型在設(shè)備終端,尤其是手機(jī)和筆記本電腦的部署,掃清一個(gè)又一個(gè)障礙,也預(yù)示著2024年,消費(fèi)類電子產(chǎn)品,將會(huì)迎來(lái)一波大模型加載的高潮。

這些“小”模型的推出,有一個(gè)共同的特征,就是采用了高質(zhì)量的數(shù)據(jù),“教科書(shū)級(jí)”的數(shù)據(jù)。無(wú)疑,主流新聞媒體的檔案,所能提供的是好的語(yǔ)言訓(xùn)練材料。

蘋(píng)果正在與美國(guó)各大媒體機(jī)構(gòu)談判,約以5000萬(wàn)美元的價(jià)格,獲得這些媒體的檔案語(yǔ)料庫(kù),用來(lái)訓(xùn)練自己的大模型,可能會(huì)用Siri的對(duì)話服務(wù)。

想想這些用來(lái)訓(xùn)練語(yǔ)料的品質(zhì)吧,康迪納斯特的Vogue、New Yorker、NBC News,以及IAC的People、The Daily Beast、Better Homes、 Gardens等。它包括大量的以時(shí)尚與生活方式為內(nèi)容的精美文字和圖片。也包括部分新聞文章、圖片和視頻。

但是其他的主流媒體對(duì)此沒(méi)有表示出多少興趣。以往紙媒與社交媒體的合作,并沒(méi)有給他們帶來(lái)多少利益。另外,媒體將其檔案中的新聞交給蘋(píng)果去訓(xùn)練大模型,在使用的過(guò)程中,可能產(chǎn)生的法律糾紛,也引起這些媒體的擔(dān)憂。

蘋(píng)果的做法,被認(rèn)為更加地道。其他的AI公司或者科技巨頭,是先用了人家的語(yǔ)料,被揪住了再去談授權(quán),已經(jīng)引發(fā)了一些官司。

蘋(píng)果出于對(duì)隱私的強(qiáng)調(diào),它不愿意直接從網(wǎng)絡(luò)上扒數(shù)據(jù)。蘋(píng)果也不允許收集其客戶的數(shù)據(jù)。

那么,2024年蘋(píng)果會(huì)做什么?

大家首先想到的是,它會(huì)在明年推出生成式AI加持的語(yǔ)言助理Siri。它將是2024年秋季iPhone16和iOS18的最大亮點(diǎn)。有些果粉開(kāi)玩笑說(shuō)會(huì)推出SiriGPT。但這些都只是冰山一角。

巨頭的做法,通常是尋找新的技術(shù)加強(qiáng)其固有的核心能力,在原有的產(chǎn)品上產(chǎn)生差異化。是從表面上看,吃老本的蘋(píng)果,在生成式AI上行動(dòng)遲緩,采取了保守的跟隨戰(zhàn)略?還是蘋(píng)果能真正利用其在芯片、操作系統(tǒng)、大模型方面一體化整合的能力和產(chǎn)品設(shè)計(jì)能力,做出最好的AI產(chǎn)品體驗(yàn)?答案可能是后者。

蘋(píng)果在過(guò)去的幾年,已經(jīng)收購(gòu)了幾十家AI初創(chuàng)企業(yè),用于其產(chǎn)品、服務(wù)及生態(tài)中。只是這里面沒(méi)有那些明星級(jí)的初創(chuàng)公司。

蘋(píng)果只做不說(shuō),早有分析人士注意到,蘋(píng)果在AI上的投資,一點(diǎn)都不比微軟少:已經(jīng)花了上百億美元,建造生成式AI應(yīng)用開(kāi)發(fā)的基礎(chǔ)設(shè)施。稍早人們傳聞蘋(píng)果在內(nèi)部偷訓(xùn)自己的大模型Ajax,或者叫Apple GPT,據(jù)說(shuō)當(dāng)時(shí)能趕上GPT-3.5.

但最近蘋(píng)果在機(jī)器學(xué)習(xí)方面一系列的研究成果表明,蘋(píng)果在走自己的路。微軟、谷歌、亞馬遜、英偉達(dá),以及OpenAI為代表的閉源大模型公司,圍繞模型、云和算力去收割了第一茬。

而蘋(píng)果看重的是其20億設(shè)備及其用戶所形成的巨大的生態(tài)。生成式AI所帶來(lái)的iPhone的新的體驗(yàn),以及用大模型去加持所有的應(yīng)用,這些給蘋(píng)果帶來(lái)的消費(fèi)市場(chǎng)機(jī)會(huì),是其他巨頭難以?shī)Z走的。蘋(píng)果以隱私保護(hù)的名義,控制了第三方應(yīng)用之間互相竄訪,這也讓蘋(píng)果商店成為自己未來(lái)AI應(yīng)用的金礦。

蘋(píng)果動(dòng)作慢了嗎?生成式AI的幻覺(jué)問(wèn)題,還有監(jiān)管、隱私保護(hù)、版權(quán)糾紛等,這些問(wèn)題都會(huì)令蘋(píng)果想得更深一些,考慮得更周全一些。蘋(píng)果有這樣的底氣,因?yàn)樗谛酒⒉僮飨到y(tǒng)、應(yīng)用、產(chǎn)品、制造等各個(gè)層面一體化的設(shè)計(jì),最終所帶來(lái)的產(chǎn)品體驗(yàn)創(chuàng)新性的深度,仍將可能是其競(jìng)爭(zhēng)對(duì)手難以比擬的。

OpenAI引發(fā)的“iPhone時(shí)刻”,已經(jīng)尖叫好幾回了,但下一個(gè)蘋(píng)果,還是蘋(píng)果。更多股票資訊,關(guān)注財(cái)經(jīng)365!